警惕AI换脸诈骗新型“淫叫”音频合成技术深度伪造风险

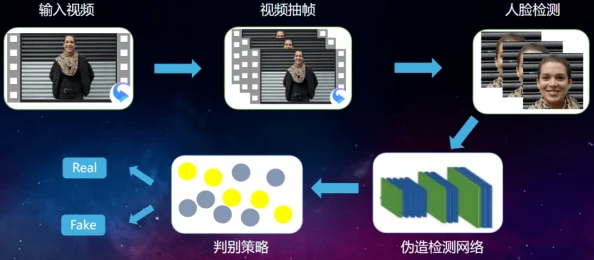

最新消息显示,随着技术的不断进步,深度伪造技术正在迅速发展。尤其是换脸和音频合成技术的结合,使得诈骗手段愈加隐蔽和复杂。这一现象引发了社会各界的广泛关注与讨论。

深度伪造技术的崛起

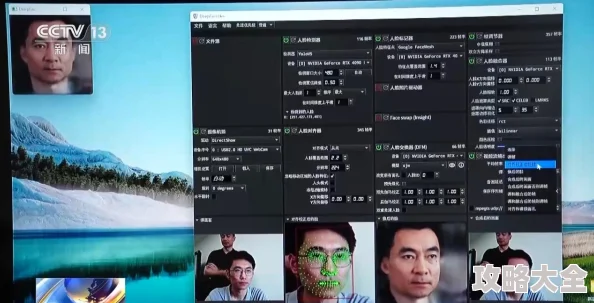

深度伪造技术利用机器学习算法,可以生成高度逼真的视频和音频内容。根据《计算机视觉与模式识别》期刊的一项研究,这种技术不仅可以模拟人的面部表情,还能重现声音特征,从而使得虚假信息更具迷惑性。例如,一些不法分子通过合成名人或公众人物的视频,进行恶意传播,以达到诈骗目的。这种新型“淫叫”音频合成方式,让受害者在毫无防备中陷入骗局。

网友对此表示担忧,有评论指出:“这种技术太可怕了,我们很难再相信网络上的任何东西。”另一位用户则提到:“我希望相关部门能够加强监管,保护我们免受这些新型诈骗的侵害。”

社会影响与应对措施

深度伪造带来的风险不仅限于个人财产安全,更可能对社会信任造成严重打击。根据《心理学报》的研究,人们对于信息来源的信任感正在逐渐降低。在这样的背景下,如何提高公众对深度伪造内容的警惕性显得尤为重要。一些专家建议,通过教育和宣传,提高大众对这一问题的认识,是遏制此类犯罪行为的重要途径。

不少网友也积极分享自己的看法。有评论认为:“我们需要更多的信息素养教育,让大家都能辨别真假。”还有人呼吁:“科技公司应该承担起责任,加强产品审核机制,不让这些工具被滥用。”

未来展望:科技与伦理并行

面对日益严峻的挑战,各界开始探讨如何在享受科技便利时,也要兼顾伦理道德。《人工智能伦理学》一书中提到,“科技的发展必须以人为本”,这意味着在推动创新时,应考虑其潜在影响,并制定相应规范。此外,一些国家已经开始立法,对使用深度伪造技术进行欺诈行为设定法律责任,以增强威慑力。

许多网友对此表示支持,有人说:“立法是必要的,但更重要的是提升全社会对这一问题的认知。”也有观点认为:“只有当每个人都意识到这个问题,我们才能真正抵御这种风险。”

面对如此复杂的问题,我们不禁思考:

如何有效识别深度伪造内容?

- 提高媒体素养、了解常见特征,如不自然的人物动作或语调变化等,可以帮助识别虚假信息。

科技公司应采取哪些措施来防止其产品被滥用?

- 加强审核机制、提供用户举报渠道以及开展反欺诈宣传活动都是有效的方法。

社会各界如何共同努力来减少此类诈骗事件发生?

- 政府、企业及公众需形成合力,通过立法、教育及舆论监督,共同营造一个安全的信息环境。

参考资料:

- 《计算机视觉与模式识别》

- 《心理学报》

- 《人工智能伦理学》